NLP İçin En Etkili Yapay Zekâ Modelleri

—

NLP İçin En Etkili Yapay Zekâ Modelleri

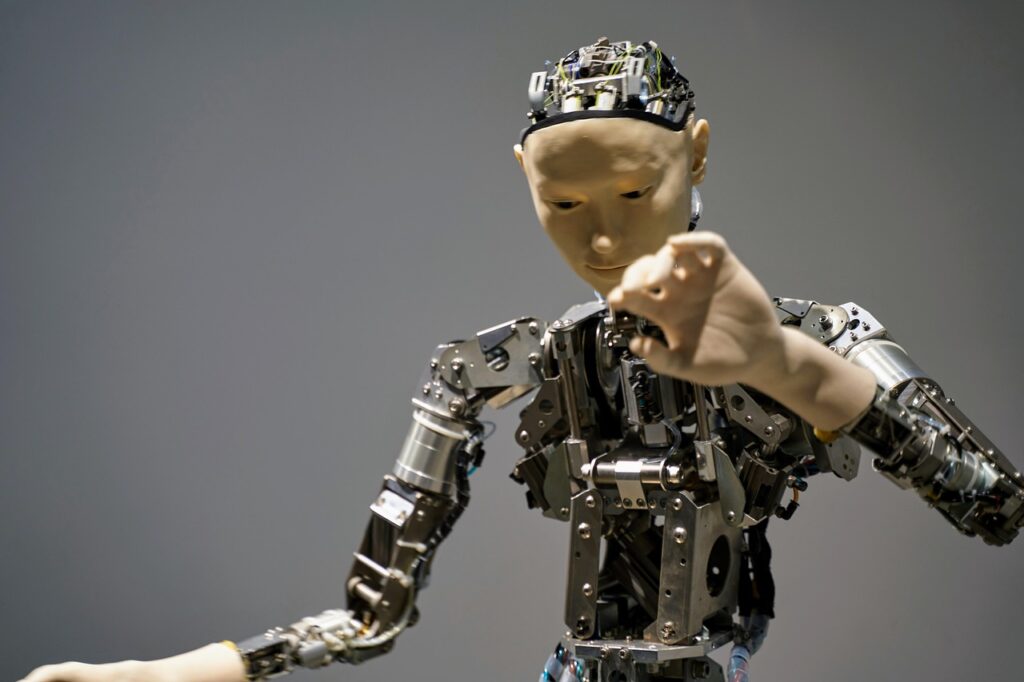

Doğal Dil İşleme (NLP), insan dilini anlamlandırmak ve işlemek için yapay zekâ teknolojilerini kullanan bir disiplindir. Son yıllarda büyük veri setleri ve gelişmiş algoritmalar sayesinde NLP uygulamaları hayatımızın vazgeçilmez bir parçası haline gelmiştir. Bu alandaki ilerlemeler, makinelerin metinleri analiz etmesine, çeviri yapmasına, özetlemesine ve hatta doğal dilde yanıtlar üretmesine olanak tanımaktadır. NLP’nin sağladığı bu yetenekler, müşteri hizmetlerinden tıbbi teşhise, eğitimden hukuka kadar geniş bir yelpazede devrim niteliğinde değişimler yaratmaktadır. Bu nedenle, doğru yapay zekâ modelini seçmek, bir NLP projesinin başarısı için kritik öneme sahiptir.

# Transformer Mimarisi ve Temelleri

Transformer mimarisi, 2017 yılında Google tarafından tanıtıldığından bu yana doğal dil işleme alanında adeta bir devrim yarattı. Geleneksel yinelemeli sinir ağlarının (RNN) aksine, bu mimari paralelleştirmeye olanak tanıyan dikkat mekanizmalarını kullanır. Bu özellik, uzun metin dizilerindeki bağımlılıkları çok daha etkin bir şekilde yakalamasını sağlar. Başka bir deyişle, transformer modelleri bir cümlenin veya belgenin farklı bölümleri arasındaki ilişkileri daha derinlemesine anlayabilir. Bu mimarinin başarısı, özellikle büyük ölçekli dil modellerinin geliştirilmesinin önünü açmıştır. Örneğin, BERT ve GPT gibi popüler modellerin temelini oluşturarak NLP performansında önemli sıçramalar gerçekleştirmiştir.

# BERT: İki Yönlü Kodlayıcı Temsilleri

BERT (Bidirectional Encoder Representations from Transformers), Transformer mimarisini temel alan ve Google tarafından geliştirilen güçlü bir modeldir. Geleneksel modellerin aksine, BERT bir kelimenin bağlamını hem solundan hem de sağından iki yönlü olarak analiz eder. Bu, kelimenin anlamını çok daha doğru bir şekilde kavramasını sağlar. Maskelenmiş dil modellemesi ve sonraki cümle tahmini gibi ön eğitim görevleriyle donatılmıştır. Sonuç olarak, bu model metin sınıflandırma, soru yanıtlama ve duygu analizi gibi birçok NLP görevinde rekor sonuçlar elde etmiştir. Geliştiriciler, BERT’i kendi özel veri setleri üzerinde ince ayar yaparak belirli uygulama alanlarında yüksek başarı elde edebilirler.

# GPT Modelleri: Üretken Dil Yetenekleri

OpenAI tarafından geliştirilen Generative Pre-trained Transformer (GPT) serisi modeller, özellikle üretken dil yetenekleriyle ön plana çıkmaktadır. Transformer mimarisinin kod çözücü (decoder) kısmını kullanarak eğitilen bu modeller, bir önceki kelimelere bakarak sonraki kelimeleri tahmin etme yeteneğine sahiptir. Bu nedenle, insan benzeri metinler, makaleler, şiirler ve hatta kod parçaları üretebilirler. GPT-2, GPT-3 ve son olarak GPT-4 gibi modeller, metin özetlemeden içerik oluşturmaya, sohbet robotlarından sanal asistanlara kadar geniş bir yelpazede uygulama alanı bulmuştur. Bununla birlikte, bu modellerin boyutu ve karmaşıklığı, bilgi işlem kaynakları açısından önemli gereksinimler ortaya koyar.

# RNN ve LSTM: Sekans Verilerinin İşlenmesi

Yinelemeli Sinir Ağları (RNN), sıralı verileri işlemek için tasarlanmış ilk başarılı yapay zekâ modellerindendir. Bir kelimenin anlamını anlamak için önceki kelimelerin bağlamını kullanır. Ancak, uzun dizilerdeki bağımlılıkları öğrenmede “uzun süreli bağımlılık” sorunları yaşayabilir. Bu sorunu çözmek için geliştirilen Uzun Kısa Süreli Bellek (LSTM) ağları, özel bellek hücreleri ve kapı mekanizmaları sayesinde daha uzun dizilerdeki bilgileri tutabilir. Başka bir deyişle, LSTM’ler çeviri, konuşma tanıma ve zaman serisi analizi gibi görevlerde RNN’lerden daha başarılı olmuştur. Bununla birlikte, transformer modellerinin ortaya çıkışı, birçok NLP görevinde LSTM’lerin yerini almıştır, ancak belirli niş uygulamalarda hala kullanılmaktadırlar.

# Uygulama Alanları ve Gelecek Perspektifleri

NLP destekli yapay zekâ modellerinin uygulama alanları oldukça geniştir ve sürekli olarak genişlemektedir. Müşteri hizmetlerinde chatbotlar ve sanal asistanlar, kullanıcı sorgularını anlamak ve yanıtlamak için bu modelleri kullanır. Tıp alanında, elektronik sağlık kayıtlarından bilgi çıkarımı ve teşhis destek sistemleri geliştirilir. Ek olarak, finans sektöründe piyasa duyarlılığı analizi ve dolandırıcılık tespiti gibi görevlerde de bu teknolojilerden faydalanılır. Gelecekte, daha gelişmiş modeller insan-bilgisayar etkileşimini daha da doğal hale getirecek, kişiselleştirilmiş öğrenme deneyimleri sunacak ve karmaşık yasal belgelerin analizini otomatikleştirecektir. Bu nedenle, NLP yapay zekâsı birçok endüstrideki operasyonları dönüştürmeye devam edecektir.

# Doğru Modeli Seçme Kriterleri

Bir NLP projesi için en etkili yapay zekâ modelini seçmek, projenin özel ihtiyaçlarına bağlıdır. İlk olarak, projenin amacı netleştirilmelidir: metin sınıflandırma mı, metin üretimi mi, yoksa çeviri mi yapılacak? Modelin boyutu ve karmaşıklığı, mevcut bilgi işlem kaynakları ile uyumlu olmalıdır; örneğin, daha küçük bir model sınırlı kaynaklarla daha verimli çalışabilir. Ayrıca, modelin eğitileceği veri setinin boyutu ve kalitesi de önemli bir kriterdir. Örneğin, niş bir alan için genel bir model yerine, ilgili alanda önceden eğitilmiş bir model daha iyi sonuçlar verebilir. Sonuç olarak, performans, ölçeklenebilirlik ve kullanım kolaylığı gibi faktörleri dikkate alarak en uygun modeli seçmek projenin başarısını doğrudan etkiler.

Yorum Yap

Yorumunuz onaylandıktan sonra yayımlanacaktır. Lütfen argo içermeyen yorumlar gönderin.